Nerdcore.de: Das beste über Technik, Gaming & Lifestyle

In der heutigen digitalen Welt gibt es unzählige Plattformen, die sich mit Technik, Gaming und Nerdkultur beschäftigen. Doch Nerdcore.de hebt sich durch seine einzigartige Mischung aus fundiertem Wissen, spannenden News und einer lebendigen Community hervor. Egal, ob du Technikfreak, Gaming-Enthusiast oder einfach nur neugierig auf die neuesten Trends in der digitalen Welt bist – Nerdcore.de bietet dir genau das, was du suchst.

Neueste Beiträge

- Lizenzierte Online Casinos

Lizenzierte Online Casinos geben ein sicheres Gefühl beim Spielen! Doch wie worauf es wirklich ankommt erfahren Sie hier!

Lizenzierte Online Casinos geben ein sicheres Gefühl beim Spielen! Doch wie worauf es wirklich ankommt erfahren Sie hier! - Paysafecard Online Casinos

Paysafecard Online Casinos werden immer beliebter, und das aus guten Grund! Hier alles Wichtige auf einen Blick!

Paysafecard Online Casinos werden immer beliebter, und das aus guten Grund! Hier alles Wichtige auf einen Blick! - Online Casinos ohne Konto

Online Casinos ohne Konto sind eine super alternative wenn Sie einfach und sofort spielen wollen. Doch wie funktioniert das ?

Online Casinos ohne Konto sind eine super alternative wenn Sie einfach und sofort spielen wollen. Doch wie funktioniert das ? - Online Casinos im Ausland

Online Casinos im Ausland werden unter den Spielern immer beliebter da sie sehr viele Vorteile bieten! Aber gibt es auch Nachtweile ?

Online Casinos im Ausland werden unter den Spielern immer beliebter da sie sehr viele Vorteile bieten! Aber gibt es auch Nachtweile ? - Mobile Online Casinos: Unterwegs auf dem Handy Slots spielen

Mobile Online Casinos gewinnen immer mehr an Beliebtheit! Aber stimmt es wirklich, dass man mittlerweile von überall aus spielen kann?

Mobile Online Casinos gewinnen immer mehr an Beliebtheit! Aber stimmt es wirklich, dass man mittlerweile von überall aus spielen kann? - Online Casinos mit hohen Einsätzen

Online Casinos mit hohen Einsätzen sind natürlich sehr beliebt! Hier sind alle Vor- und Nachteile auf einen Blick!

Online Casinos mit hohen Einsätzen sind natürlich sehr beliebt! Hier sind alle Vor- und Nachteile auf einen Blick!

Ratgeber

- Der Spielerunmut auf Grund eines vom Markt genommenen ComputerspielsIn der heutigen Zeit steht es im Grunde genommen nicht mehr auf der Tagesordnung, dass… Der Spielerunmut auf Grund eines vom Markt genommenen Computerspiels weiterlesen

- Die beliebtesten Online Games: Zocken ganz ohne EquipmentOnline Games lassen sich bequem im Browser oder auf dem Smartphone spielen, ohne dass man teure Hardware oder spezielles Zubehör benötigt. Dieser Trend macht das Zocken zugänglicher denn je, für Einsteiger genauso wie für passionierte Gamer.

- Bewerbungshomepage: Vorteile, Nachteile & TippsÜber Sinn und Unsinn einer Bewerbungshomepage lässt sich trefflich streiten: Auf der einen Seite stehen… Bewerbungshomepage: Vorteile, Nachteile & Tipps weiterlesen

- Handwerker suchen: Diese Webseiten machen es easyIn deiner Wohnung steht eine Reparatur oder eine Renovierung an? Und du hast gerade leider… Handwerker suchen: Diese Webseiten machen es easy weiterlesen

- Lebenslauf: Ehrenamtliche Tätigkeiten richtig angebenDu engagierst dich in deiner Freizeit ehrenamtlich? Dann liegt es zweifellos nahe, deine Einsatzbereitschaft auch… Lebenslauf: Ehrenamtliche Tätigkeiten richtig angeben weiterlesen

- Lebenslauf-Inhalt: Darauf kommt es anEin guter Lebenslauf ist die Voraussetzung für die Einladung zum Vorstellungsgespräch und somit auch potenziell… Lebenslauf-Inhalt: Darauf kommt es an weiterlesen

Vorlagen

- Bewerbungsdeckblatt: Vorlagen & Muster als DownloadDu suchst ein Deckblatt für deine Bewerbung? Nachfolgend findest du Vorlagen für dein Bewerbungsdeckblatt, die… Bewerbungsdeckblatt: Vorlagen & Muster als Download weiterlesen

- Kündigungsvorlagen: Kostenloser Download & individuell anpassbarDu bist auf der Suche nach einer Kündigungsvorlage? Dann bist du hier genau richtig! Finde… Kündigungsvorlagen: Kostenloser Download & individuell anpassbar weiterlesen

- Entschuldigungsschreiben: Vorlagen, Muster & BeispieleEs ist oft unbeabsichtigt, kommt aber immer wieder vor: Man hat jemand anderen durch seine… Entschuldigungsschreiben: Vorlagen, Muster & Beispiele weiterlesen

- Lebenslauf-Vorlagen & -Muster 2025: Kostenlos als DownloadDu suchst eine Vorlage für deinen Lebenslauf? Nachfolgend findest du Lebenslauf-Vorlagen für verschiedene Tätigkeiten, die… Lebenslauf-Vorlagen & -Muster 2025: Kostenlos als Download weiterlesen

- Office-Vorlagen: Kostenlose Muster für dein BüroDu möchtest deine Arbeit schneller erledigen? Hier findest du verschiedenste Office-Vorlagen für dein Büro, die… Office-Vorlagen: Kostenlose Muster für dein Büro weiterlesen

- Fahrtenbuch: 5 Vorlagen, Muster & BeispieleEin Fahrtenbuch dokumentiert die Nutzung eines Fahrzeugs. Sowohl ein Angestellter als auch ein Selbstständiger profitieren… Fahrtenbuch: 5 Vorlagen, Muster & Beispiele weiterlesen

Tutorials

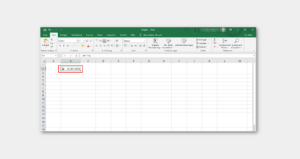

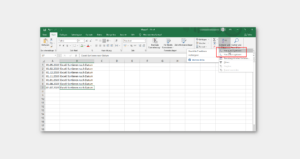

- Excel: Aktuelles Datum einfügenDu möchtest in deiner Excel-Tabelle immer das heutige Datum angezeigt bekommen. Ob bei der Neuberechnung… Excel: Aktuelles Datum einfügen weiterlesen

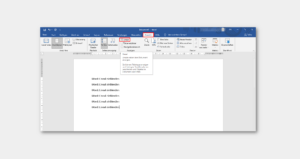

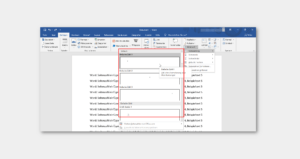

- Word Lineal einblenden: So einfach geht'sDas Lineal in Microsoft Word ist ein unverzichtbares Werkzeug für die präzise Formatierung und Ausrichtung… Word Lineal einblenden: So einfach geht's weiterlesen

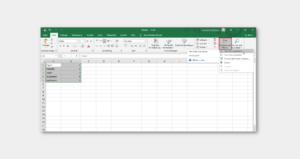

- Excel: Nach Alphabet sortierenDu möchtest deine Excel-Tabelle strukturieren? Kein Problem! In Excel kannst du deine Liste alphabetisch sortieren… Excel: Nach Alphabet sortieren weiterlesen

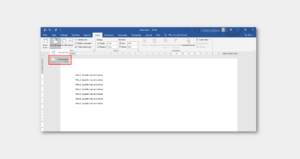

- Word: Querformat einstellenWenn du zum Beispiel größere Tabellen oder Grafiken in deinem Word-Dokument verwendest, kann es Sinn… Word: Querformat einstellen weiterlesen

- Excel: Sortieren nach DatumDu hast in deiner Excel-Tabelle mehrere Ereignisse mit einem Datum aufgelistet und möchtest diese nun… Excel: Sortieren nach Datum weiterlesen

- Word: Seitenzahl einfügenDu hast einen längeren Text in Word erstellt und möchtest nun Seitenzahlen in das Word-Dokument… Word: Seitenzahl einfügen weiterlesen

Nerdcore.de – Deine Anlaufstelle für alles rund um Technik, Gaming und digitale Kultur

Technik, die begeistert

Auf Nerdcore.de findest du regelmäßig aktuelle News und tiefgehende Artikel zu den neuesten Entwicklungen in der Technikbranche. Von innovativen Gadgets über bahnbrechende Software bis hin zu spannenden Hardware-Tests – hier bleibt kein Technikfan außen vor. Die Beiträge sind dabei stets verständlich geschrieben, sodass auch Einsteiger problemlos folgen können, ohne auf spannende Details verzichten zu müssen. So macht Technik lesen Spaß und inspiriert dazu, selbst Neues auszuprobieren.

Gaming – mehr als nur ein Hobby

Gaming ist längst nicht mehr nur ein Zeitvertreib, sondern eine Kultur, die Millionen Menschen weltweit verbindet. Nerdcore.de nimmt dich mit auf eine Reise durch die Welt der Videospiele – von Retro-Klassikern bis zu den neuesten Blockbustern. Reviews, Tipps und Tricks, Hintergrundberichte zu Spieleentwicklungen und spannende Interviews mit Branchen-Insidern sorgen dafür, dass du immer am Puls der Zeit bleibst. Dabei steht der Spaß am Spiel und die Leidenschaft für das Medium im Vordergrund.

Digitale Kultur und Lifestyle

Nerdcore.de versteht sich nicht nur als Technik- und Gaming-Portal, sondern auch als Plattform für digitale Kultur. Themen wie Social Media, Streaming, E-Sports oder die neuesten Trends aus der Welt der Apps und Online-Services werden hier ebenso behandelt. So entsteht ein umfassendes Bild der digitalen Welt, das weit über reine Technik hinausgeht und die vielfältigen Facetten unserer vernetzten Gesellschaft beleuchtet.

Community und Austausch

Was Nerdcore.de besonders auszeichnet, ist die lebendige Community. Hier treffen Gleichgesinnte aufeinander, um sich auszutauschen, zu diskutieren und gemeinsam neue Ideen zu entwickeln. Ob in Foren, Kommentaren oder bei speziellen Events – der Austausch steht im Mittelpunkt. So entsteht ein Ort, an dem Wissen geteilt und neue Freundschaften geknüpft werden können.

Gerne! Da keine spezifische Zielgruppe oder Brand Voice vorgegeben ist, verfasse ich den Text in einem klaren, informativen und zugleich sympathischen Stil, der Technik- und Nerd-Interessierte anspricht.

Die Entstehung von Nerdcore.de – Wie eine Leidenschaft zur Plattform wurde

Nerdcore.de ist heute eine feste Größe für alle, die sich für Technik, Gaming und digitale Kultur begeistern. Doch wie hat eigentlich alles angefangen? Die Geschichte von Nerdcore.de ist eine Geschichte von Leidenschaft, Community und dem Wunsch, Wissen zu teilen.

Alles begann vor einigen Jahren, als eine Gruppe von Technik- und Gaming-Enthusiasten feststellte, dass es zwar viele Websites gibt, die einzelne Themen abdecken, aber kaum eine Plattform, die all diese Bereiche unter einem Dach vereint. Die Gründer von Nerdcore.de wollten genau das ändern: Einen Ort schaffen, an dem Nerds aller Couleur zusammenkommen können – egal, ob sie sich für die neuesten Hardware-Trends, spannende Games oder digitale Lifestyle-Themen interessieren.

Mit viel Engagement und Know-how starteten sie zunächst mit einem kleinen Blog, in dem sie ihre Erfahrungen, Tests und Gedanken teilten. Schnell zeigte sich, dass das Interesse groß war: Immer mehr Leser fanden den Weg zu Nerdcore.de und schätzten die authentische, fundierte und dennoch leicht verständliche Art der Beiträge. Die Community wuchs, und mit ihr die Vielfalt der Themen.

Im Laufe der Zeit entwickelte sich Nerdcore.de von einem Hobbyprojekt zu einer professionellen Plattform. Das Team wurde größer, die Inhalte vielfältiger und die technischen Möglichkeiten moderner. Heute bietet Nerdcore.de nicht nur News und Tests, sondern auch Interviews, Hintergrundberichte und eine lebendige Community, die sich aktiv austauscht.

Was Nerdcore.de besonders macht, ist die Kombination aus Fachwissen und Leidenschaft. Die Gründer und Autoren sind selbst Nerds, die ihre Begeisterung teilen und dabei stets den Blick für die Bedürfnisse ihrer Leser haben. So entstand eine Marke, die für Qualität, Verlässlichkeit und Spaß an der digitalen Welt steht.

Die Entstehung von Nerdcore.de zeigt, wie aus einer einfachen Idee und echter Begeisterung eine Plattform wachsen kann, die Menschen verbindet und inspiriert. Wer heute Nerdcore.de besucht, spürt diese Leidenschaft in jedem Artikel und jeder Diskussion – und wird Teil einer Community, die Technik und digitale Kultur lebt.